실험 개요

Anthropic의 3에이전트 아키텍처 논문에서 제시한 "컨텍스트 분리가 품질을 높인다"는 주장을 2D Maze 게임으로 직접 검증한 실험이다.

원시 프롬프트: "웹 브라우저에서 PC(키보드)와 모바일(터치/스와이프) 모두 플레이 가능한 2D Maze 게임. 미로 자동 생성(난이도 점진 증가), 다중 레벨, 타이머, 글로벌 리더보드, 부드러운 애니메이션, 사운드 이펙트, 반응형 UI, 다크/라이트 테마. 전세계 1등 Maze 게임을 목표로."

실험 설계

통제 변수 (의도): 역할 구성(플래너+생성기+평가기), 도구(Playwright MCP), 평가 기준, 반복 횟수(최대 20회)

독립 변수: 컨텍스트 분리 여부

- Method B (1세션): 서브에이전트 1개가 플래너→생성기→평가기 역할을 같은 세션에서 전환. 코드를 직접 읽을 수 있는 상태에서 자기 결과물을 평가.

- Method D (분리 세션): 매 단계마다 새 서브에이전트 생성 (독립 컨텍스트). 평가기는 생성기의 의도를 모르고, 파일만 받고 판단.

실험 후 발견된 한계: Method B의 평가기는 Playwright를 실제로 사용하지 않고 코드 리뷰로 평가를 수행했다 (eval 파일에 소스코드 라인 번호 직접 참조, 스크린샷 0장). 따라서 컨텍스트 분리와 평가 방법(코드 리뷰 vs Playwright), 두 변수가 동시에 다르다. 또한 N=1이라 통계적 유의성이 없다. 탐색적 사례 연구로 해석해야 한다.

결과 스크린샷

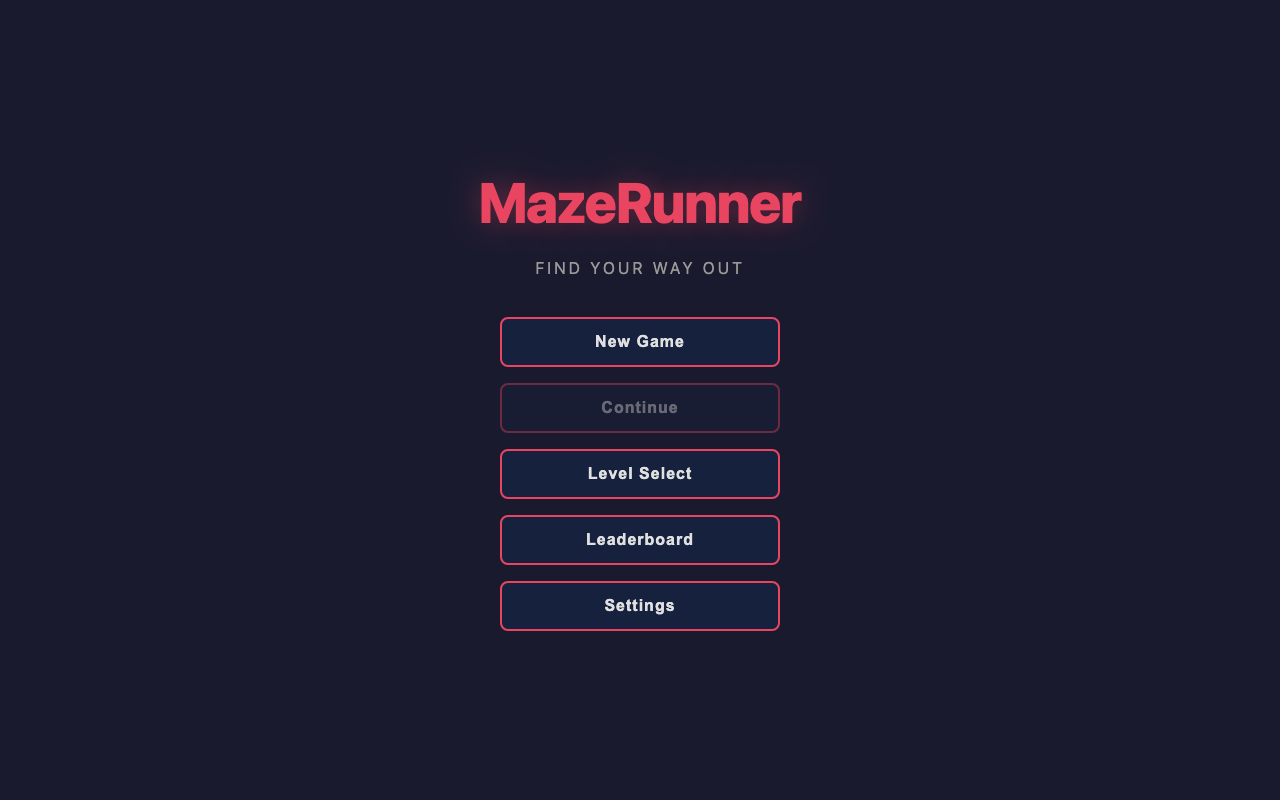

Method B — 1세션 (컨텍스트 공유)

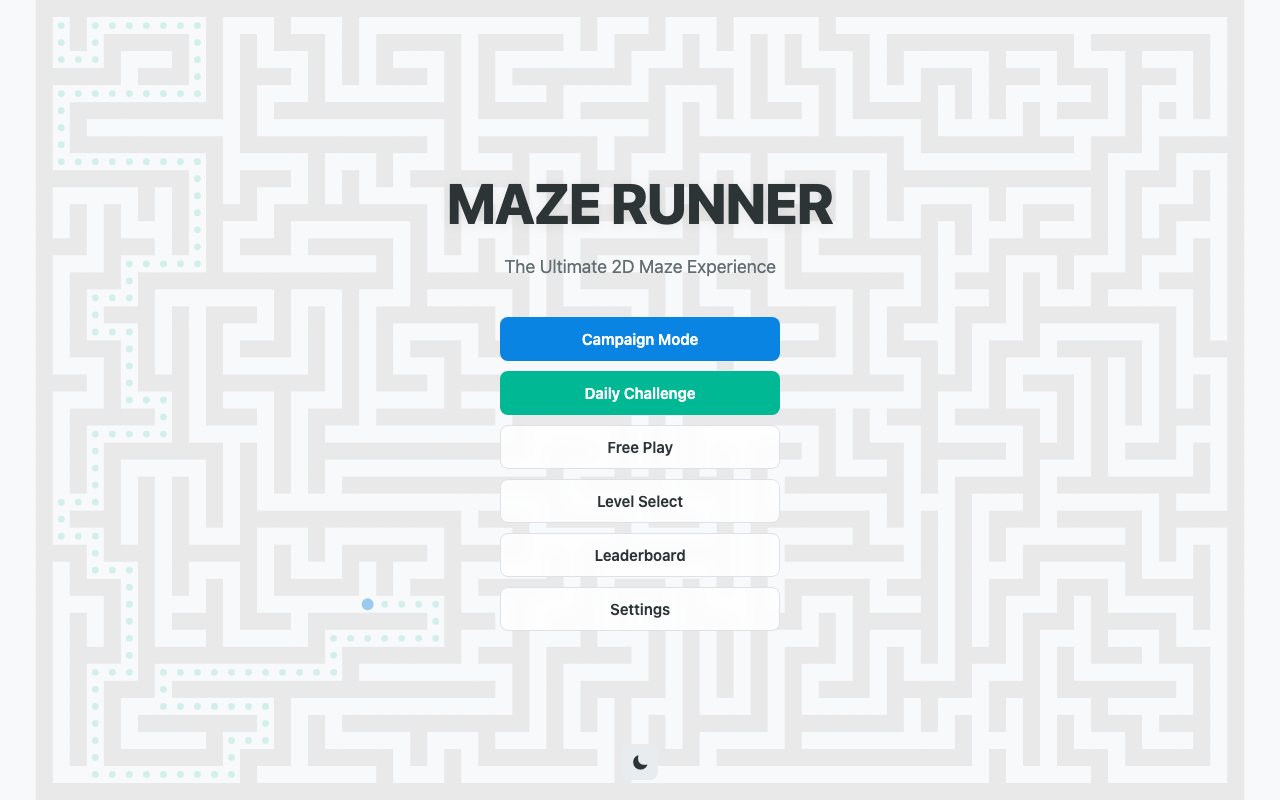

Method D — 분리 세션 (컨텍스트 독립)

최종 비교표

이터레이션 추이

핵심 관찰

1. 품질 차이는 관찰되었으나, 원인 귀속에 한계가 있다

Method D(17점)가 Method B(16점)보다 1점 높았다. 핵심 차이는 기능 깊이(B=4 vs D=5). 독립 플래너가 더 넓은 기능 범위를 설계하고, 독립 평가기가 더 엄격하게 평가한 경향은 일관되게 관찰되었다. 그러나 B의 평가기가 Playwright를 사용하지 않은 교란 변수가 있어, 이 차이가 컨텍스트 분리만의 효과인지는 단정할 수 없다.

2. Method B의 평가기가 특정 문제를 반복적으로 놓침

Method B의 평가기가 3회 반복 동안 발견하지 못한 문제 2개:

- 캔버스 400px 고정: PC 1920x1080에서 캔버스가 400x400으로 렌더링. 독립 비교 평가기가 즉시 발견.

- 리더보드 정적 데이터: 하드코딩된 샘플 10명만 표시.

이것이 "자기 맹점"(컨텍스트 공유의 효과)인지, 평가 방법의 차이(코드 리뷰 vs Playwright)인지는 분리할 수 없다. 캔버스 크기 문제는 브라우저에서만 확인 가능하므로 Playwright 미사용이 주된 원인일 가능성이 높다.

3. 의도치 않은 발견: 코드 접근이 가능하면 Playwright를 안 쓴다

Playwright 사용을 지시했음에도 Method B의 평가기는 코드를 직접 읽는 방식을 선택했다. 같은 세션에서 코드에 접근할 수 있으면 굳이 브라우저를 열지 않는 경향 — 이것 자체가 컨텍스트 공유의 흥미로운 부작용일 수 있다. Method D의 평가기는 코드 접근 없이 Playwright만 사용하도록 설계되어 있었다.

4. 비용 효율 vs 품질의 트레이드오프

D는 토큰 7.2배(598,735 vs 83,502), 시간 9배(~90분 vs ~10분) 더 소비했으나 점수 차이는 1점(5%). N=1이라 이 차이가 유의미한지는 판단할 수 없으나, D의 기능 범위가 정성적으로 더 넓었던 것은 뚜렷하다.

타당성 위협 (Threats to Validity)

| 위협 | 설명 | 완화 가능성 |

|---|---|---|

| 교란 변수 | B는 Playwright 미사용(코드 리뷰), D는 사용. 컨텍스트 분리와 평가 방법 두 변수가 동시에 다름. | 재실험 시 Playwright 강제 사용 메커니즘 필요 |

| N=1 | 각 Method 1회 실행. 통계적 검정 불가. LLM의 비결정성으로 재현 시 결과가 달라질 수 있음. | 5회+ 반복 실행, temperature 고정 |

| 순서 효과 | 항상 B를 먼저 실행. 카운터밸런싱 없음. | ABBA 설계 또는 무작위 순서 |

| 평가자 편향 | AI가 AI를 평가. 채점자 간 신뢰도(inter-rater reliability) 미검증. | 사람 평가자 병행, Cohen's kappa 측정 |

| 일반화 한계 | 단일 태스크(Maze 게임), 단일 모델(Claude Opus 4.6). | 다양한 태스크/모델로 확장 |

결론

Anthropic 논문의 핵심 주장 — 컨텍스트 분리가 품질을 높인다 — 과 일치하는 경향이 이 사례에서 관찰되었다. 독립 평가기는 더 엄격했고, 독립 플래너는 더 넓은 기능 범위를 설계했다.

그러나 교란 변수(Playwright 사용 여부)와 N=1의 한계로, 이 결과를 인과적 증거로 제시할 수는 없다. 탐색적 사례 연구로서, 향후 통제된 실험의 가설을 제공하는 것이 이 실험의 가치다.

실무적 시사점: 빠른 프로토타이핑에는 단일 세션이, 높은 품질이 필요한 경우에는 컨텍스트 분리가 유리할 수 있다 — 단, 비용은 7배 이상 증가한다.

실험 일시: 2026-03-27, 환경: Claude Opus 4.6 (1M context) + Playwright MCP. 탐색적 사례 연구(N=1).

Member discussion: